コラム・特集

5分でわかる【AI画像解析/画像検知】非エンジニア向けに基礎知識を解説!

ミック経済研究所の調査によると、AI画像解析の市場は2018~2023年度まで平均成長率95.1%増を続け、2023年度には、1500億円市場になると予測している。

今後はさらに活用の場が広がるだろう。

本記事では、AI・人工知能活用を考えるビジネスパーソン向けに、AI画像解析によってどのようなことが実現できるのか紹介していこう。

画像認識自体の研究は、コンピューターが登場する前から行われてきた。「OCR」(Optical Character Reader)での文字読み取りや、iPhoneで採用されている顔認証なども画像解析に含まれる。

しかし子どもでも簡単にできる「モノの識別」は、コンピューターにとってはとても難しく、長い間日の目を見ることはなかった。

それが2010年代に入ると、技術革新のひとつとして画像解析が大きな注目を集めることとなる。

その象徴的な出来事が2012年に開催された世界的な画像解析コンテスト「ImageNet Large Scale Visual Recognition Challenge」だ。この時、ディープラーニングを使った機械学習モデルが、他のモデルに圧倒的な精度で大差をつけて勝利した。

この出来事が画像解析の実用化に弾みをつけ、今では一般の人でもAIを意識することなく生活のなかで使っている。

画像解析が実用化されたのは、ディープラーニング技術の誕生、そしてハードウェアの進化が大きい。

ディープラーニングは深層学習とも呼ばれるAIの一種であり、機械学習に含まれる。機械学習は大量のデータから学習し、運用後も間違いを訂正していくことで、どんどん賢くなっていくという優位性が注目されている。

そんな機械学習の中でもディープラーニングは、画像から特徴量を自律的に検出することで、高い精度を達成した。

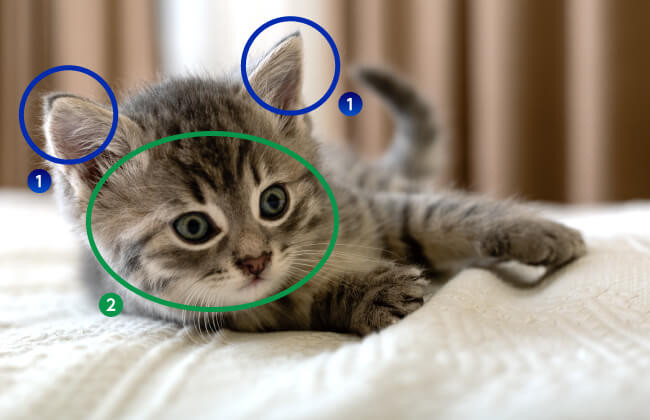

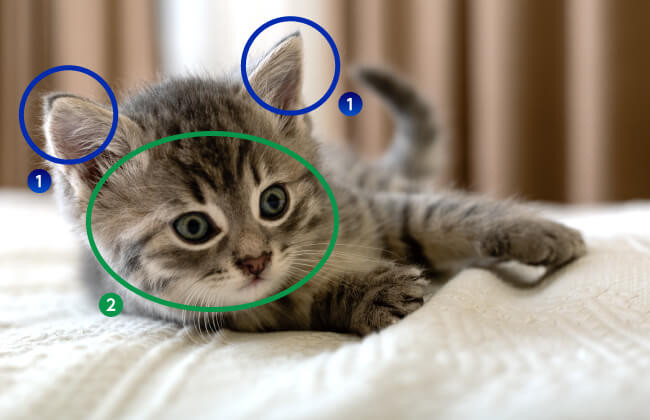

例えば、上の画像が「猫」であるということを判断するための固有の特徴である「1. 耳が2つあってそれは頭頂よりも上にある」「2. 顔の輪郭は丸い」といったことを、人間が定義しなくてもデータの中からAIが判断してくれるようになる。

では、具体的にAI画像解析は、どんなことができて、どんなふうに活用できるのかを見ていこう。

まず、AI画像解析には、大きく分けて「分類」「検出」「生成」の機能がある。

「分類」はAI画像解析の基本となる機能で、画像に何が写っているかを識別する。

例えば、次の写真では「車」を識別したり「都市」を識別したりと、撮影対象だけでなく、背景に写っているものや、どの場所にいるかを解析する。そして、それが「車」なのか「人」なのか「建物」なのかを1枚の画像から分ける=分類するわけだ。

「検出」は、画像に何が写っているかだけでなく、画像のどの位置に対象物が写っているかを識別する。

また、画像に写っているさまざまなモノが、どのくらい遠くにあるのかを識別する。

例えば広いスペースの飲食店で、どの席が空いているかを判断するといったことに使われている。

また、画像から建物、歩道、道路といったように、映像に写っているエリアをカテゴライズして抽出することができる。

その場にいる人の個人情報を考慮する場合や、自動運転で走行ルートを決定する場合に利用されている。

「GAN」(敵対的生成ネットワーク)はディープラーニングの進化系ともいうべきもので、架空あるいは実在の人物や動物を画像として生成できる。この「生成」も画像解析によってもたらされる成果のひとつだ。

実在の人物として生成するとフェイク画像として悪用される問題もあるが、AIが学習するために必要な画像データを大量に生成する際にも活用されている。

それではAI画像解析の基本となる「分類」の仕組みを紹介しよう。

「画像に何が写っているか?」人間にとってこの問いに答えるのは簡単だ。だが、前にも触れたようにこれをコンピューターに置き換えると、とたんに難しくなる。

例えば、猫を見分けるには、猫がどういう形をしているかを定義する必要がある。

「猫には耳が2つあってそれは頭頂よりも上にある」「顔の輪郭は丸い」と言葉で表すと簡単だが、コンピューターに反映させるには、耳はどんなものか、顔とはどんなものか、といったことについても逐一定義しなければならない。

この定義を人間が行ったらどうなるかを想像してみてほしい。膨大な作業量になるし、言語化できない部分も多数あることがわかるだろう。

そもそも私たち人間は、モノを識別する時に、細かな特徴をその都度言語化しているわけではない。幼いころに「これは猫だよ」などと教えてもらい、無意識のうちに猫の特徴を抽出して記憶しているのだ。

それと同じようなことを実現したのがディープラーニングである。

どのように解析しているのかプロセスを簡単に見てみよう。

画像から何かを識別するには、パターンを抽出する必要がある。そのためには大量のデータが必要だ。

さらに、学習用のデータには、「猫」「犬」「イノシシ」のように、画像に正解となる「タグ」を付ける必要がある。

このように学習用データに正解を与える学習方法を「教師あり学習」と呼ぶ。そして正解をタグ付けする作業を「アノテーション」と呼び、大量のデータ一つひとつに行う必要がある。

ちなみに、2012年にGoogleが発表した研究では、タグ付けを行わずに猫を識別できたが、ある画像から何かを識別したい場合には、通常はアノテーションを行う必要がある。

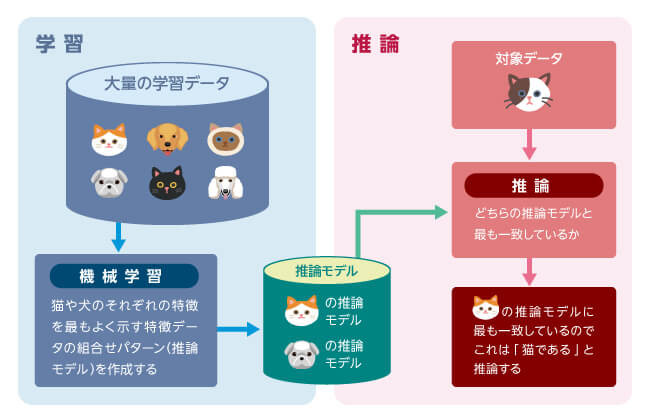

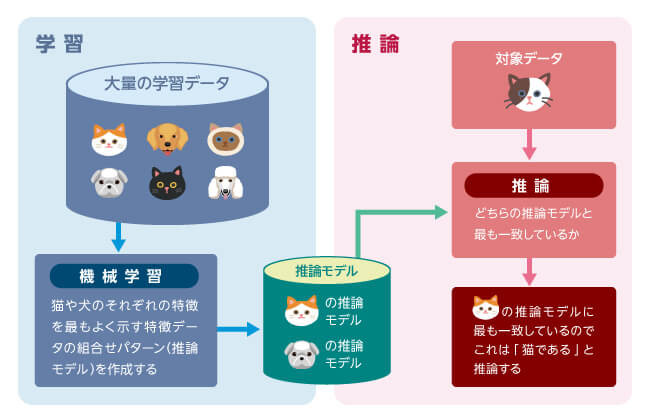

事前に用意した学習用データを読み込み、タグで示すモノについて特徴的である部分を抽出し、組み合わせパターンによって猫向け、犬向けといった推論モデルをそれぞれ作成する。

学習データとは別の画像を入力し、どの推論モデルと一致しているのかを調べ、「猫である確率が90%」といった判定を行う。

このような手順を踏むと、例えば画像をアップロードしたら、タイプに応じて画像を自動的に分類したり、何が写っているかを識別したりすることができるようになる。

従来の単純な機械学習では、猫について「耳が2つあってそれは頭頂よりも上にある」「顔の輪郭は丸い」といった特徴的なパターンの抽出は人間が定義しなければならなかった。

しかし、ディープラーニングの登場により、画像を画素(ピクセル単位)にまで分解して輪郭や目や鼻の識別を高い精度でできるようになったのである。これが「AI画像解析」の基本的な仕組みだ。

AI画像解析は古くからある技術だが、ディープラーニングの誕生によって実用化の幅が飛躍的に広がった。

AI画像解析は画像に写る何かを識別したり、その何かがどの位置にあるかを特定したり、その何かにそっくりな画像を生成したりすることができる

画像を解析するには、「データ準備」「学習」「推論」のプロセスが必要だ。そして、AI画像解析はもはや特別な機能ではなく、ビジネスに活用して、大きな成果を上げるフェーズに来たといえる。

今後はさらに活用の場が広がるだろう。

本記事では、AI・人工知能活用を考えるビジネスパーソン向けに、AI画像解析によってどのようなことが実現できるのか紹介していこう。

そもそも、AI画像解析ってなに?

画像認識自体の研究は、コンピューターが登場する前から行われてきた。「OCR」(Optical Character Reader)での文字読み取りや、iPhoneで採用されている顔認証なども画像解析に含まれる。

しかし子どもでも簡単にできる「モノの識別」は、コンピューターにとってはとても難しく、長い間日の目を見ることはなかった。

それが2010年代に入ると、技術革新のひとつとして画像解析が大きな注目を集めることとなる。

その象徴的な出来事が2012年に開催された世界的な画像解析コンテスト「ImageNet Large Scale Visual Recognition Challenge」だ。この時、ディープラーニングを使った機械学習モデルが、他のモデルに圧倒的な精度で大差をつけて勝利した。

この出来事が画像解析の実用化に弾みをつけ、今では一般の人でもAIを意識することなく生活のなかで使っている。

画像解析が一気に普及した理由

画像解析が実用化されたのは、ディープラーニング技術の誕生、そしてハードウェアの進化が大きい。

ディープラーニングは深層学習とも呼ばれるAIの一種であり、機械学習に含まれる。機械学習は大量のデータから学習し、運用後も間違いを訂正していくことで、どんどん賢くなっていくという優位性が注目されている。

そんな機械学習の中でもディープラーニングは、画像から特徴量を自律的に検出することで、高い精度を達成した。

例えば、上の画像が「猫」であるということを判断するための固有の特徴である「1. 耳が2つあってそれは頭頂よりも上にある」「2. 顔の輪郭は丸い」といったことを、人間が定義しなくてもデータの中からAIが判断してくれるようになる。

AI画像解析には何ができる?

では、具体的にAI画像解析は、どんなことができて、どんなふうに活用できるのかを見ていこう。

まず、AI画像解析には、大きく分けて「分類」「検出」「生成」の機能がある。

(1)分類

「分類」はAI画像解析の基本となる機能で、画像に何が写っているかを識別する。

例えば、次の写真では「車」を識別したり「都市」を識別したりと、撮影対象だけでなく、背景に写っているものや、どの場所にいるかを解析する。そして、それが「車」なのか「人」なのか「建物」なのかを1枚の画像から分ける=分類するわけだ。

(2)検出

「検出」は、画像に何が写っているかだけでなく、画像のどの位置に対象物が写っているかを識別する。

また、画像に写っているさまざまなモノが、どのくらい遠くにあるのかを識別する。

例えば広いスペースの飲食店で、どの席が空いているかを判断するといったことに使われている。

また、画像から建物、歩道、道路といったように、映像に写っているエリアをカテゴライズして抽出することができる。

その場にいる人の個人情報を考慮する場合や、自動運転で走行ルートを決定する場合に利用されている。

(3)生成

「GAN」(敵対的生成ネットワーク)はディープラーニングの進化系ともいうべきもので、架空あるいは実在の人物や動物を画像として生成できる。この「生成」も画像解析によってもたらされる成果のひとつだ。

実在の人物として生成するとフェイク画像として悪用される問題もあるが、AIが学習するために必要な画像データを大量に生成する際にも活用されている。

AIはどのように処理しているのか? AI画像解析の仕組み

それではAI画像解析の基本となる「分類」の仕組みを紹介しよう。

「画像に何が写っているか?」人間にとってこの問いに答えるのは簡単だ。だが、前にも触れたようにこれをコンピューターに置き換えると、とたんに難しくなる。

例えば、猫を見分けるには、猫がどういう形をしているかを定義する必要がある。

「猫には耳が2つあってそれは頭頂よりも上にある」「顔の輪郭は丸い」と言葉で表すと簡単だが、コンピューターに反映させるには、耳はどんなものか、顔とはどんなものか、といったことについても逐一定義しなければならない。

この定義を人間が行ったらどうなるかを想像してみてほしい。膨大な作業量になるし、言語化できない部分も多数あることがわかるだろう。

そもそも私たち人間は、モノを識別する時に、細かな特徴をその都度言語化しているわけではない。幼いころに「これは猫だよ」などと教えてもらい、無意識のうちに猫の特徴を抽出して記憶しているのだ。

それと同じようなことを実現したのがディープラーニングである。

どのように解析しているのかプロセスを簡単に見てみよう。

1. 事前に学習用データを用意

画像から何かを識別するには、パターンを抽出する必要がある。そのためには大量のデータが必要だ。

さらに、学習用のデータには、「猫」「犬」「イノシシ」のように、画像に正解となる「タグ」を付ける必要がある。

このように学習用データに正解を与える学習方法を「教師あり学習」と呼ぶ。そして正解をタグ付けする作業を「アノテーション」と呼び、大量のデータ一つひとつに行う必要がある。

ちなみに、2012年にGoogleが発表した研究では、タグ付けを行わずに猫を識別できたが、ある画像から何かを識別したい場合には、通常はアノテーションを行う必要がある。

2. 学習

事前に用意した学習用データを読み込み、タグで示すモノについて特徴的である部分を抽出し、組み合わせパターンによって猫向け、犬向けといった推論モデルをそれぞれ作成する。

3. 推論

学習データとは別の画像を入力し、どの推論モデルと一致しているのかを調べ、「猫である確率が90%」といった判定を行う。

このような手順を踏むと、例えば画像をアップロードしたら、タイプに応じて画像を自動的に分類したり、何が写っているかを識別したりすることができるようになる。

従来の単純な機械学習では、猫について「耳が2つあってそれは頭頂よりも上にある」「顔の輪郭は丸い」といった特徴的なパターンの抽出は人間が定義しなければならなかった。

しかし、ディープラーニングの登場により、画像を画素(ピクセル単位)にまで分解して輪郭や目や鼻の識別を高い精度でできるようになったのである。これが「AI画像解析」の基本的な仕組みだ。

AI画像解析で“できること”

AI画像解析は古くからある技術だが、ディープラーニングの誕生によって実用化の幅が飛躍的に広がった。

AI画像解析は画像に写る何かを識別したり、その何かがどの位置にあるかを特定したり、その何かにそっくりな画像を生成したりすることができる

画像を解析するには、「データ準備」「学習」「推論」のプロセスが必要だ。そして、AI画像解析はもはや特別な機能ではなく、ビジネスに活用して、大きな成果を上げるフェーズに来たといえる。

WRITTEN by

建設土木のICT活用など、

デジコンからの最新情報をメールでお届けします